Тема

6. Характеристики неперервних джерел

інформації

План

1. Математичні моделі

джерел неперервних повідомлень та їх статистичні

характеристики

- Інформаційні характеристики

джерел неперервних повідомлень.

1. Математичні моделі

джерел неперервних повідомлень та їх статистичні

характеристики

У телекомунікаційних системах неперервне повідомлення a(t)

перетворюється пропорційно (без втрат інформації) у первинний сигнал b(t)

= ka(t). Виявилось зручним замість аналізу інформаційних

характеристик джерела неперервних повідомлень аналізувати інформаційні

характеристики первинного сигналу b(t). Тому в подальшому

мова йде лише про первинний неперервний сигнал b(t).

Сигнал b(t) – це реалізації стаціонарного ергодичного

випадкового процесу B(t) з його ймовірнісними характеристиками:

1)

одновимірними

функцією розподілу F(b) та густиною ймовірності p(b);

2)

середнім значенням В та дисперсією D{B};

3)

функцією кореляції KB(r) та спектральною

густиною потужності GB(r).

Всі неперервні повідомлення (еквівалентні їм дійсні первинні сигнали) мають спектри,

зосереджені в обмеженій смузі частот 0...Fmax.

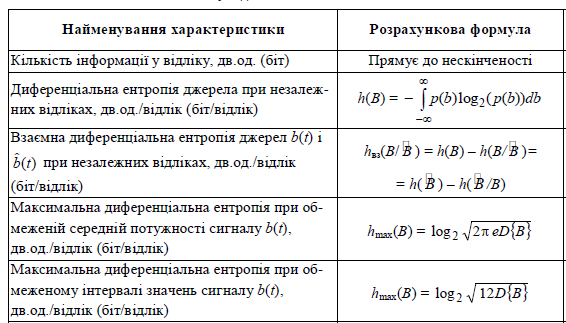

Таблиця 6.1 - Розрахункові формули інформаційних характеристик неперервного

сигналу b(t)

2. Інформаційні характеристики

джерел неперервних повідомлень

Результат не є несподіваним – кількість інформації в неперервному

по-відомленні і відповідному йому первинному сигналі b(t) прямує

до нескінченності. А це тому, що неперервне повідомлення має нескінченну

множину реалізацій, імовірність появи будь-якої з них прямує до нуля.

Інтуїтивно зрозуміло, що різні сигнали містять різну кількість інформації.

Крім того, сигнал більшої тривалості надає одержувачу більшу кількість

інфо-рмації. Тому для числової оцінки середньої кількості інформації

неперервного джерела (за аналогією з дискретним джерелом) було введено поняття

“ентропія неперервного джерела”.

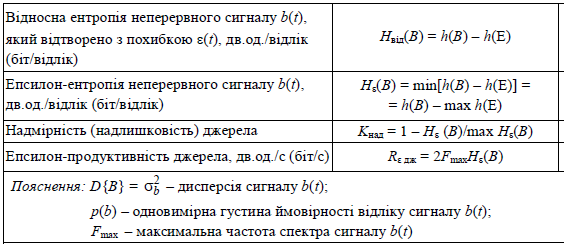

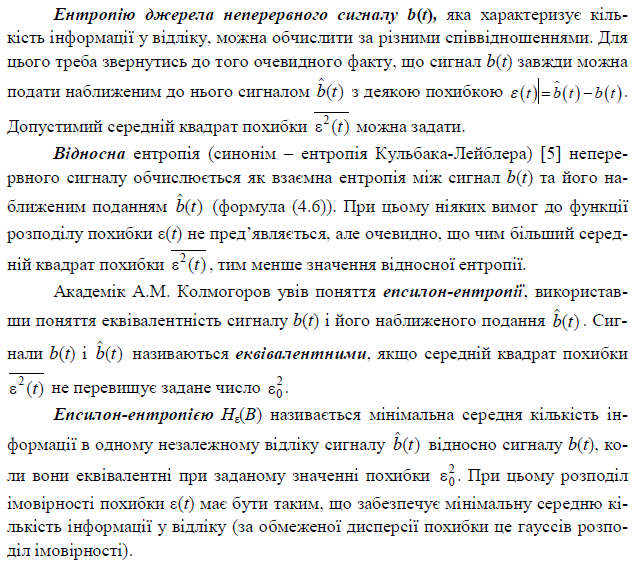

Диференціальна ентропія джерела неперервного сигналу b(t) є аналогом

ентропії джерела

дискретного повідомлення, формально обчислюється як ма-тематичне сподівання

кількості інформації у відліку за густиною ймовірності, характеризує ступінь

невизначеності джерела. Звертаємо увагу на те, що диференціальна ентропія:

·

обчислюється на

відлік, а відліки сигналу можуть бути незалежними

або залежними;

·

залежить від

дисперсії сигналу b(t) та її розмірності;

·

не показує

середньої кількості інформації у відліку, але надає можливість порівнювати

кількість інформації різних джерел.

Таблиця 6.2 - Розрахункові формули для диференціальної

ентропії (на відлік) сигналу b(t) з дисперсією D{B}

при незалежних відліках, дв.од./відлік (біт/відлік)

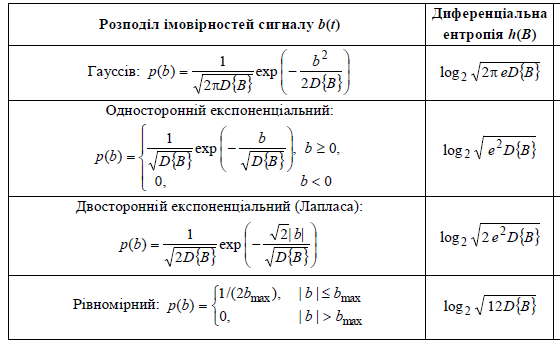

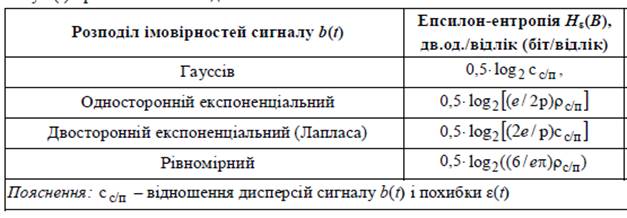

Таблиця 6.3 - Розрахункові формули

епсилон-ентропії на відлік неперервного сиг-

налу b(t) при незалежних

відліках

Продуктивність

(швидкість

видачі інформації) джерела неперервного сигналу можна обчислити, знаючи

ентропію.

Продуктивність,

обчислена за відносною ентропією, дістала назву – функція

швидкість-спотворення.